Avec l’avancée de l’intelligence artificielle, créer un deepfake réaliste est désormais à la portée de n’importe qui. Ces vidéos truquées, générées par IA, envahissent notre paysage numérique et brouillent les frontières entre réalité et fiction, avec un impact considérable sur la société

Des personnalités publiques aux dirigeants politiques en passant par les célébrités, personne n’est à l’abri de cette technologie trompeuse. Comprendre les incidents les plus marquants est essentiel pour sensibiliser le public aux dangers des deepfakes.

Découvrez le top 10 des deepfakes célèbres qui ont réussi à tromper le monde entier et les conséquences de leur propagation virale.

1. Greta Thunberg et les armes « durables »

En octobre 2023, une vidéo deepfake de Greta Thunberg a fait le tour des réseaux sociaux. Dans cette vidéo, la célèbre militante écologiste semblait promouvoir l’utilisation d’armes « durables » et « écologiques » telles que des « grenades véganes » et des « missiles biodégradables » dans les conflits armés.

La vidéo, qui détournait une interview réelle de Greta Thunberg à la BBC en novembre 2022, a rapidement suscité l’indignation et la confusion chez de nombreux internautes. Beaucoup ont cru que la jeune activiste avait réellement tenu ces propos absurdes, malgré le fait que la vidéo était clairement étiquetée comme une satire.

Ce deepfake, initialement partagé par le compte satirique @snicklink sur Twitter, Instagram et YouTube, est rapidement devenu viral. Il a suscité l’indignation de certains et a montré à quel point il est facile de tromper l’opinion avec des vidéos manipulées hyper-réalistes. Il a également soulevé des questions sur l’impact potentiel des deepfakes sur la réputation et la crédibilité des individus ciblés.

Sources et liens :

On peut trouver des extraits de ce deepfake sur YouTube, Twitter et diverses plateformes de fact-checking comme Reuters ou AFP Factuel qui ont démenti son authenticité.

- YouTube : https://www.youtube.com/watch?v=kGsW0yLYao0

- AFP Fact-check : https://factcheck.afp.com/doc.afp.com.33Z23M7

2. Bella Hadid et le conflit israélo-palestinien

En octobre 2023, un deepfake de la mannequin Bella Hadid, connue pour son soutien à la cause palestinienne, a fait le tour des réseaux sociaux. Dans cette vidéo manipulée, on voit Hadid s’excuser pour ses « remarques passées » et affirmer son soutien à Israël suite à une attaque du Hamas.

Le deepfake, qui a accumulé plus de 30 millions de vues sur Twitter, a été créé à partir d’un discours de Hadid datant de 2016 sur la maladie de Lyme. La vidéo truquée a suscité de vives réactions, beaucoup y voyant une tentative de discréditer l’engagement de la mannequin envers la Palestine.

Bella Hadid a rapidement démenti le contenu de la vidéo, réaffirmant son soutien indéfectible au peuple palestinien. Cet incident met en lumière les dangers des deepfakes et leur potentiel à manipuler l’opinion publique sur des sujets sensibles.

Le deepfake de Bella Hadid peut être trouvé sur diverses plateformes, notamment :

3. Jill Biden et la désinformation politique

En janvier 2024, un deepfake audio de Jill Biden, Première Dame des États-Unis, a été utilisé lors d’appels automatisés dans le New Hampshire. La voix synthétique, imitant à la perfection celle de Jill Biden, incitait les électeurs démocrates à ne pas se rendre aux urnes pour les primaires, prétextant que leur vote ne compterait qu’en novembre.

Cette tentative de suppression des votes a rapidement été dénoncée par les autorités et les médias locaux. Bien que le deepfake ait été démasqué assez tôt, il a tout de même semé le doute parmi certains électeurs, notamment les personnes âgées moins familières avec cette technologie.

Cet incident a mis en lumière les dangers des deepfakes dans le domaine politique et la nécessité de mettre en place des mesures pour protéger l’intégrité des processus électoraux.

Vous pouvez trouver plus d’informations sur ce deepfake sur les sites suivants :

- Vidéo du Deepfake : https://www.resemble.ai/jill-biden-deepfake/

- Le Monde : https://www.lemonde.fr/pixels/article/2024/02/26/deepfake-de-joe-biden-l-identite-du-commanditaire-devoilee_6218633_4408996.html

- Journal du Net : https://www.journaldunet.com/intelligence-artificielle/1528407-premieres-reponses-du-legislateur-et-des-acteurs-face-a-la-deferlante-des-deepfakes/

4. Hamish Blake et les dilemmes éthiques

Le deepfake impliquant Hamish Blake, un comédien australien bien connu, a suscité de nombreuses questions éthiques. Dans cette vidéo truquée, une imitation vocale extrêmement réaliste de Blake a été utilisée pour promouvoir un produit amaigrissant sous forme de bonbons. La voix générée par l’IA reproduisait fidèlement le style de parole, les intonations et même les pauses naturelles de Blake, rendant la supercherie particulièrement convaincante.

Les réactions de la communauté et des experts en intelligence artificielle ont été vives. Suite à cet incident, Hamish Blake a exprimé son inquiétude face à la précision troublante de son imitateur vocal. De nombreux internautes ont également fait part de leur indignation, appelant à un meilleur encadrement de l’utilisation des deepfakes. Cet événement a ravivé le débat sur la nécessité de développer des outils de détection des deepfakes et de renforcer la législation pour protéger les droits des individus à l’ère du numérique.

Pour en savoir plus sur ce deepfake, vous pouvez consulter des sources telles que Resemble AI et UNICRI. Ces incidents soulignent l’importance de rester vigilant face aux avancées technologiques et de promouvoir une utilisation éthique de l’IA.

5. Le CEO de LastPass et l’attaque de phishing vocal

L’incident de phishing impliquant le CEO de LastPass est un exemple frappant de l’utilisation malveillante des deepfakes vocaux. Dans ce cas, des cybercriminels ont utilisé une imitation vocale sophistiquée pour se faire passer pour le CEO de LastPass, Amir Golestan, et ont réussi à tromper des employés de l’entreprise. Le deepfake vocal a été utilisé pour demander des transferts de fonds urgents, ce qui a conduit à des pertes financières significatives pour l’entreprise.

Les conséquences de cet incident ont été graves, non seulement en termes de pertes financières, mais aussi en termes de confiance des clients et de réputation de l’entreprise.

Pour en savoir plus sur cet incident, vous pouvez consulter des sources telles que Krebs on Security et Las Vegas Review-Journal. Ces articles fournissent des détails supplémentaires sur l’attaque et ses répercussions.

6. Le deepfake de Joe Biden et l’interférence électorale

En janvier 2024, un deepfake vocal de Joe Biden a semé la confusion parmi les électeurs démocrates du New Hampshire. Ce faux appel téléphonique, imitant la voix du président américain, conseillait aux électeurs de ne pas voter lors des primaires démocrates, affirmant que leur vote serait plus utile en novembre pour l’élection présidentielle. Ce message a été perçu comme une tentative de suppression des votes et a suscité une vive réaction du public et des autorités.

L’enquête a révélé que Steve Kramer, un consultant politique travaillant pour un rival de Joe Biden, était à l’origine de ce deepfake. Cette manipulation montre une fois de plus les dangers croissants de l’utilisation de l’intelligence artificielle pour influencer les élections, et peut-être même encore plus dans les pays démocratiques.

Pour en savoir plus sur cet incident, vous pouvez consulter des articles détaillés sur Ouest-France et RTBF.

7. Taylor Swift et l’escroquerie en ligne

Un deepfake récent impliquant Taylor Swift a fait des vagues sur les réseaux sociaux, utilisant l’image et la voix de la chanteuse pour promouvoir des produits de la marque Le Creuset. Dans cette vidéo, une version générée par IA de Taylor Swift annonce une offre de sets de cuisine gratuits en raison d’une prétendue erreur d’emballage. Les fans sont invités à cliquer sur un lien et à fournir des informations personnelles pour recevoir les produits, ce qui a conduit à des vols de données et à des escroqueries financières.

Les réactions des fans ont été immédiates, beaucoup se sentant trahis et dupés par ce faux message. Le Creuset a rapidement réagi en niant toute association avec cette publicité et en travaillant activement pour faire retirer les vidéos des plateformes concernées. Les représentants de Taylor Swift n’ont pas encore commenté publiquement l’incident, mais l’impact sur la confiance des fans et la réputation de la marque a été significatif.

Les plateformes comme Facebook et TikTok ont été critiquées pour leur lenteur à réagir face à ces contenus trompeurs. Les experts en cybersécurité recommandent aux utilisateurs de vérifier l’authenticité des offres promotionnelles et de se méfier des demandes d’informations personnelles en ligne.

Pour en savoir plus sur ce deepfake, vous pouvez consulter les articles suivants :

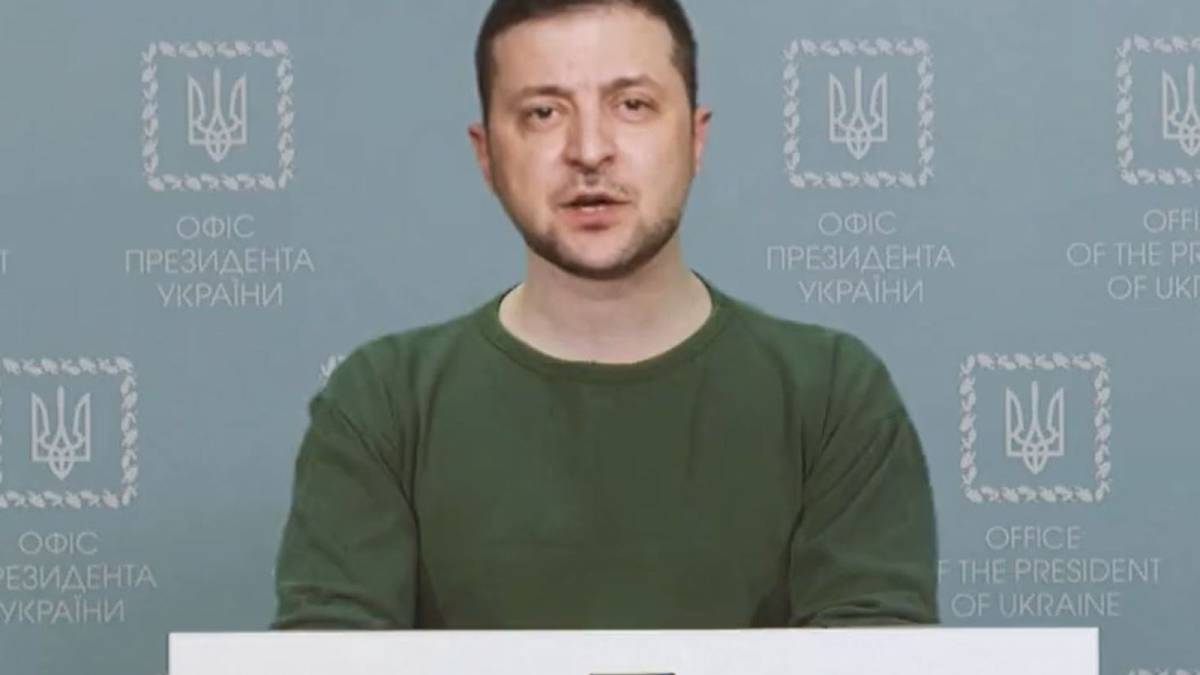

8. Volodomyr Zelenskyy et la guerre en Ukraine

En mars 2022, un deepfake du président ukrainien Volodomyr Zelenskyy a fait surface sur les réseaux sociaux et sur le site piraté de la chaîne d’information Ukraine 24. Dans cette vidéo truquée, Zelenskyy appelait les soldats ukrainiens à déposer les armes et à se rendre face à l’invasion russe. La vidéo, bien que rapidement démentie et supprimée des plateformes comme Facebook, YouTube et Twitter, a semé la confusion et a été largement partagée sur les réseaux sociaux russes.

Ce deepfake visait à saper le moral des troupes ukrainiennes et à briser la confiance du public envers leur président. Cependant, la qualité médiocre de la vidéo, avec des incohérences dans la synchronisation des lèvres et un accent incorrect, a permis à de nombreux internautes de détecter la supercherie. Zelenskyy a rapidement réagi en publiant une vidéo sur Telegram, réaffirmant la détermination de l’Ukraine à défendre son territoire et ses citoyens.

Les deepfakes, en tant qu’outils de propagande, peuvent être utilisés pour manipuler l’opinion publique et déstabiliser des nations entières.

Pour en savoir plus sur ce deepfake, vous pouvez consulter les articles suivants :

9. Ron DeSantis et la campagne politique

Lors de la campagne présidentielle américaine de 2024, un deepfake impliquant Ron DeSantis, Donald Trump et Anthony Fauci a fait grand bruit. Ce deepfake, diffusé par le compte Twitter « DeSantis War Room », montrait des images de Trump embrassant Fauci, un geste qui n’a jamais eu lieu. Ces images ont été créées à l’aide de l’intelligence artificielle pour donner l’impression que Trump et Fauci étaient des alliés proches, ce qui a suscité de vives réactions dans le camp républicain.

Les experts en forensique numérique ont rapidement identifié ces images comme étant des deepfakes. Les anomalies dans les textures et les poses irréalistes des personnages ont permis de déceler la supercherie. Cette manipulation visait à discréditer Trump en le présentant comme un soutien de Fauci, une figure controversée parmi les conservateurs en raison de sa gestion de la pandémie de COVID-19.

L’utilisation de ces deepfakes dans la campagne de DeSantis a soulevé des questions éthiques et légales sur l’usage de l’IA dans les campagnes politiques. Les réactions ont été mitigées, certains dénonçant une atteinte à l’intégrité des élections, tandis que d’autres y voyaient une simple tactique de campagne.

Pour en savoir plus sur ce deepfake, vous pouvez consulter les articles suivants :

10. Rashmika Mandanna et les deepfakes explicites

Les deepfakes explicites impliquant l’actrice indienne Rashmika Mandanna ont récemment fait la une des médias, suscitant une vive indignation. Dans ces vidéos, le visage de Rashmika est superposé sur le corps d’une autre personne, créant l’illusion d’une scène compromettante. Ces deepfakes ont été largement diffusés sur les réseaux sociaux, provoquant une réaction immédiate de la part de l’actrice et de ses fans.

Rashmika Mandanna a exprimé publiquement ses préoccupations concernant ces vidéos, les qualifiant de « terrifiantes » et soulignant l’importance de sensibiliser le public aux dangers des deepfakes. Elle a reçu un soutien massif de la part de la communauté cinématographique et de ses fans, qui ont condamné ces actes de cyberharcèlement.

Les autorités ont rapidement réagi en lançant une enquête approfondie. Le principal suspect, un ingénieur nommé Eemani Naveen, a été arrêté par la police de Delhi. Naveen a avoué avoir créé et diffusé ces vidéos pour augmenter le nombre de followers sur une page de fans dédiée à Rashmika Mandanna. Cette affaire a mis en lumière les lacunes des plateformes de médias sociaux en matière de détection et de suppression de contenus manipulés.

Pour en savoir plus sur cette affaire, vous pouvez consulter les articles suivants :

Conclusion

L’importance de la vigilance face aux deepfakes ne peut être sous-estimée. Ces manipulations sophistiquées peuvent avoir des conséquences graves, allant de la désinformation politique à l’atteinte à la vie privée. Il est crucial que le public soit conscient des dangers potentiels et apprenne à identifier ces faux contenus.

Les technologies de détection jouent un rôle essentiel dans la lutte contre les deepfakes. Des outils avancés, basés sur l’intelligence artificielle, permettent de repérer les anomalies et de protéger l’intégrité des informations en ligne.

Enfin, les régulations légales doivent évoluer pour mieux encadrer l’utilisation des deepfakes. Des lois plus strictes et des sanctions appropriées sont nécessaires pour dissuader les abus et protéger les individus et les institutions contre ces menaces numériques.